파커 세미나는 이번이 두 번째다.

작년엔 최대한 알아들으려고 노력했지만, 시차 적응 실패와 비루한 영어 실력이 합쳐지니 결국 그대로 자거나 호텔에서 수업 듣기를 포기했다. 돈 내고 라스베이거스까지 가서 강의장에서 졸았다.

이번엔 좀 다르게 하고 싶었다.

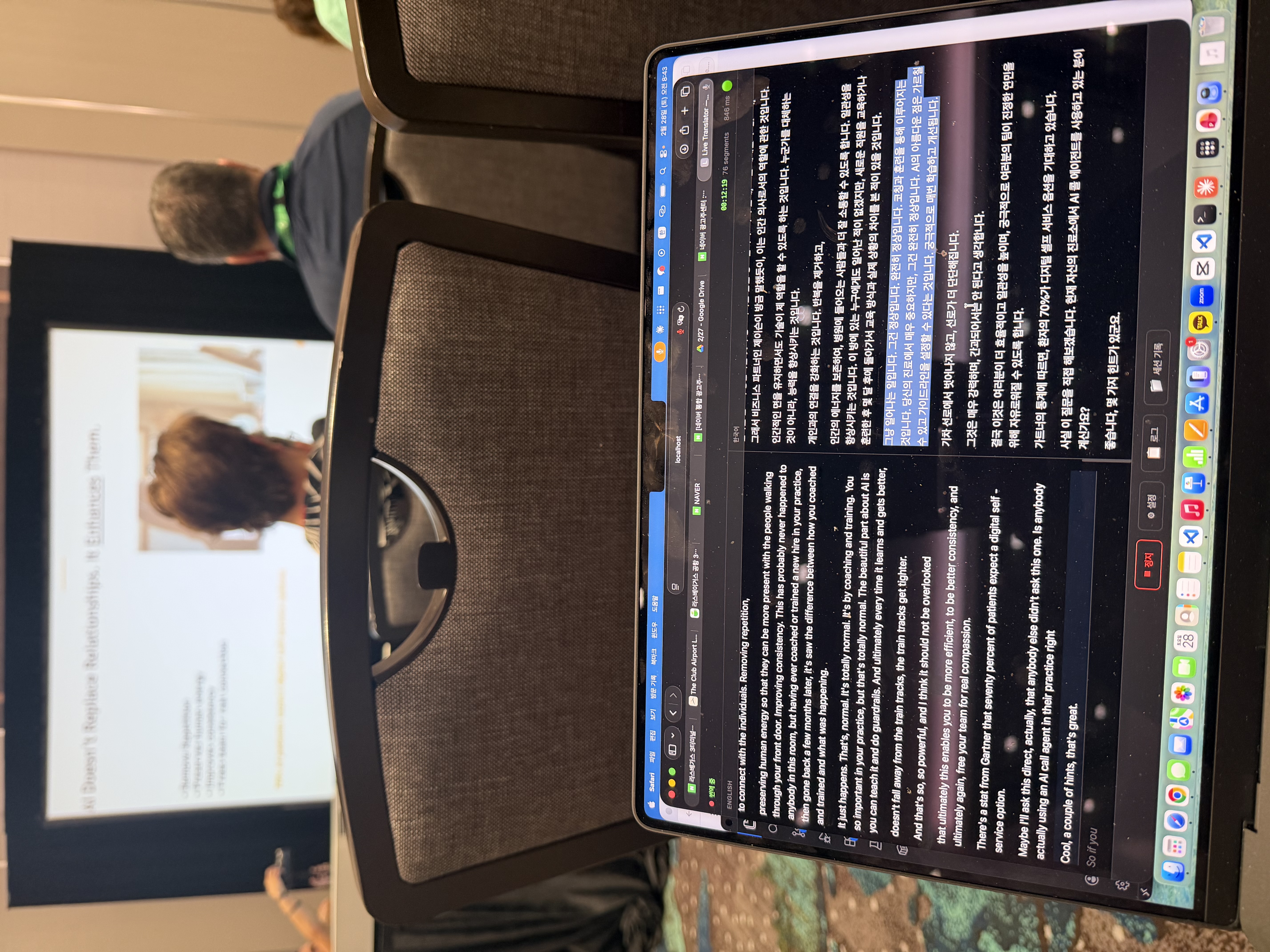

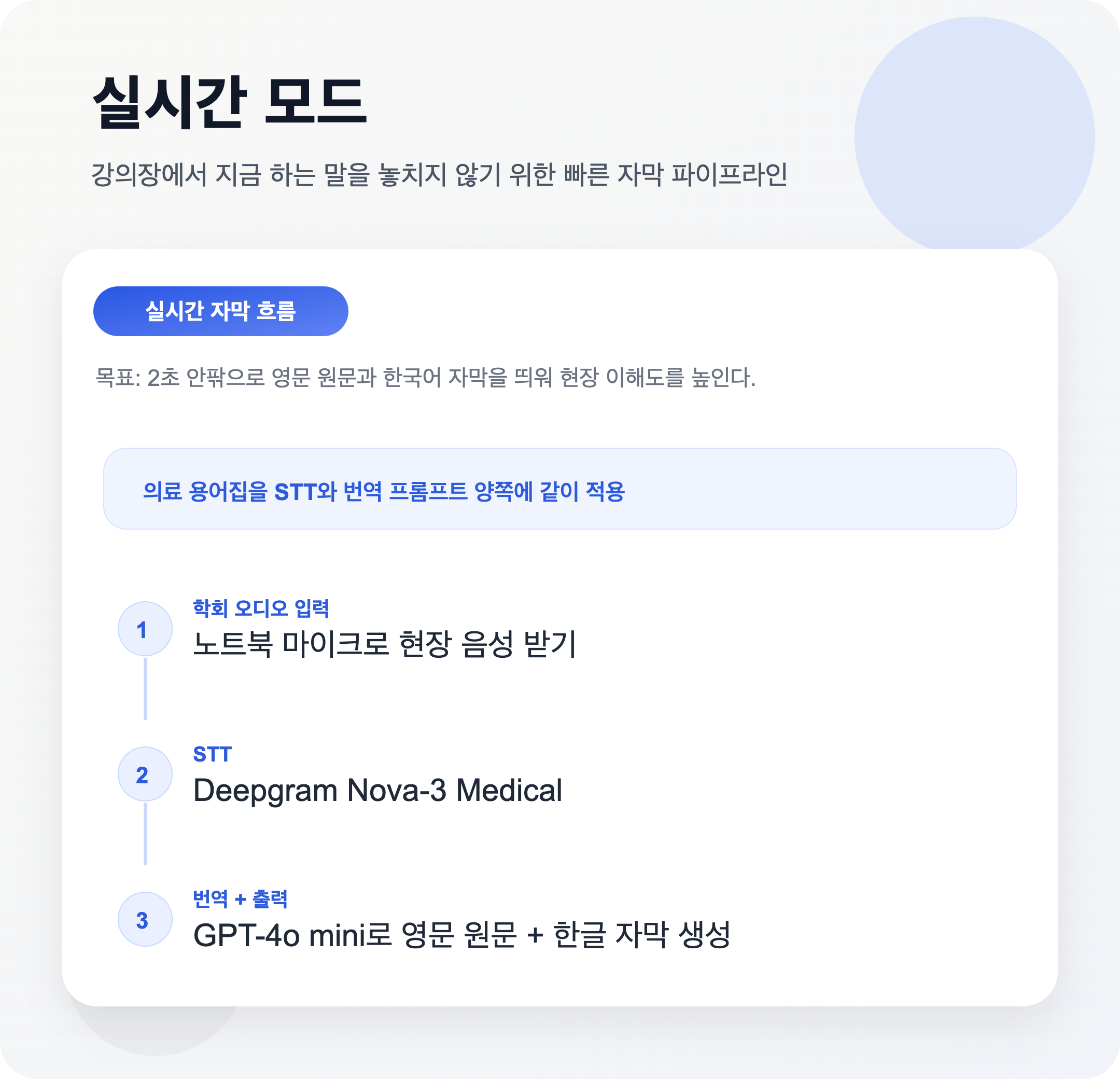

이 글은 영어 학회 실시간 번역을 위해 내가 직접 만든 파이프라인을 Parker Seminar 2026 현장에서 써본 기록이다. Deepgram Nova-3 Medical로 영어 음성을 받아적고, GPT-4o mini로 한국어 자막을 붙였고, 의료 용어집으로 용어 일관성을 맞췄다.

정리하면 이렇다.

- 목표: 영어 학회 세션을 들으면서 2초 안팎으로 한국어 자막을 확인하는 것

- 구성: Deepgram Medical STT + GPT-4o mini 번역 + 의료 용어집

- 결과: 완벽한 번역기는 아니었지만, 현장 이해도를 올리는 데는 충분했다

이 글은 정량 벤치마크가 아니라 실제 학회장에서 써본 개인 사용기다. 숫자나 평가는 내 장비, 네트워크, 세션 환경 기준으로 읽는 편이 맞다.

시중에 뭐가 있나 찾아봤다

네이버 클로바 노트는 영어 녹음도 되고 후처리도 된다. 근데 실시간이 아니다. 강의 끝나고 정리용으로는 쓸 수 있지만, 지금 이 말이 뭔지 세션 중에 알고 싶을 때는 소용이 없다.

삼성 갤럭시에 실시간 번역 기능이 있다고 나중에 알았다. 근데 나는 애플이다. 패스.

남은 건 직접 만드는 것뿐이었다.

뭘 만들어야 하나

구조 자체는 단순하다.

목소리 → 글자로 변환(STT) → 한국어로 번역

STT부터 찾아봤다. 맥에서 돌리는 로컬 위스퍼(Whisper)가 있는데, 성능 좋은 모델을 쓰려면 리소스를 너무 많이 잡아먹는다. 학회장에서 노트북 팬이 계속 돌아가는 상황은 피하고 싶었다.

검색하다 Deepgram을 찾았다. API 방식이라 로컬 리소스 부담이 적고, 테스트 크레딧도 있어서 바로 검증해볼 수 있었다. Deepgram엔 Nova-3 Medical이라는 의료 특화 모델이 따로 있다. 통증의학과에서 일하다 보니 proprioception, subluxation, chiropractic adjustment 같은 단어가 자막에서 틀리면 이해도가 확 떨어진다. 그래서 이 모델을 골랐다.

번역은 어떤 LLM을 쓸지가 문제였다. 성능이야 좋은 모델이 낫겠지만 실시간이라는 제약이 있다. 내 기준에선 2초 안에 번역이 나와야 자막이 의미가 있다. 이것저것 테스트해보다가 GPT-4o mini로 결정했다. 내가 시험한 조합들 중에서는 속도와 품질 균형이 가장 무난했다.

여기에 의료 용어집을 하나 만들어 붙였다. 카이로프랙틱과 스포츠의학에서 자주 나오는 용어들을 미리 정리해서, Deepgram STT 단계에서 힌트로 넘기고 GPT 번역 때도 "이 단어는 이렇게 번역하라"고 지정하는 방식이다. 내 테스트 범위에서는 이 단계가 들어가고 나서 번역 일관성이 확실히 좋아졌다.

만드는 건 생각보다 금방 됐다. 한두 시간 만에 돌아가는 버전이 나왔다.

집에서 테스트하다 생긴 문제

집에서 유튜브 영어 영상으로 테스트하니 잘 됐다.

티비로 틀어놓고 해보니 안 됐다. 포집이 제대로 안 됐다. 환경 문제인가 싶어서 방법을 바꿨다. 핸드폰 마이크가 더 잘 잡혀서, 핸드폰과 컴퓨터를 IP로 연결한 뒤 핸드폰 음성을 컴퓨터로 넘기는 방식으로 실험했다. 그렇게 하니 잘 됐다.

준비 완료라고 생각했다.

정작 미국에서는

학회장 와이파이가 느렸다.

핸드폰-컴퓨터 연결을 시도하니 딜레이가 생겼다. 내 현장 기준으로 실시간 자막이 3-4초씩 밀리면 의미가 없다. 결국 핸드폰 연결을 포기하고 그냥 노트북 마이크로 직접 했는데, 학회 오디오 시스템이 워낙 빵빵해서 그게 충분했다. 집 티비 테스트에서 문제였던 포집이 여기선 문제가 아니었다.

예상과 다른 방식으로 됐지만, 됐다.

실제로 써보니

GPT-4o mini 번역이 완벽하진 않다. 가끔 어색한 문장이 나왔고, 문맥을 너무 짧게 잡으면 매끄럽지 않을 때도 있었다. 그래도 영어 학회 실시간 번역이라는 목적에는 없는 것보다는 훨씬 나았다.

STT는 이 환경에선 꽤 만족스러웠다. 번역이 조금 이상해도 영어 원문이 화면에 같이 나오니까, 영어를 보면 어느 정도 이해가 됐다. 두 개가 같이 있으니 서로 보완이 됐다.

결론적으로 이번엔 강의장에서 거의 졸지 않고 다 들을 수 있었다. 적어도 나처럼 영어 청취가 애매한 상태에서 학회 내용을 따라가야 하는 사람에겐 충분히 쓸 만한 도구였다.

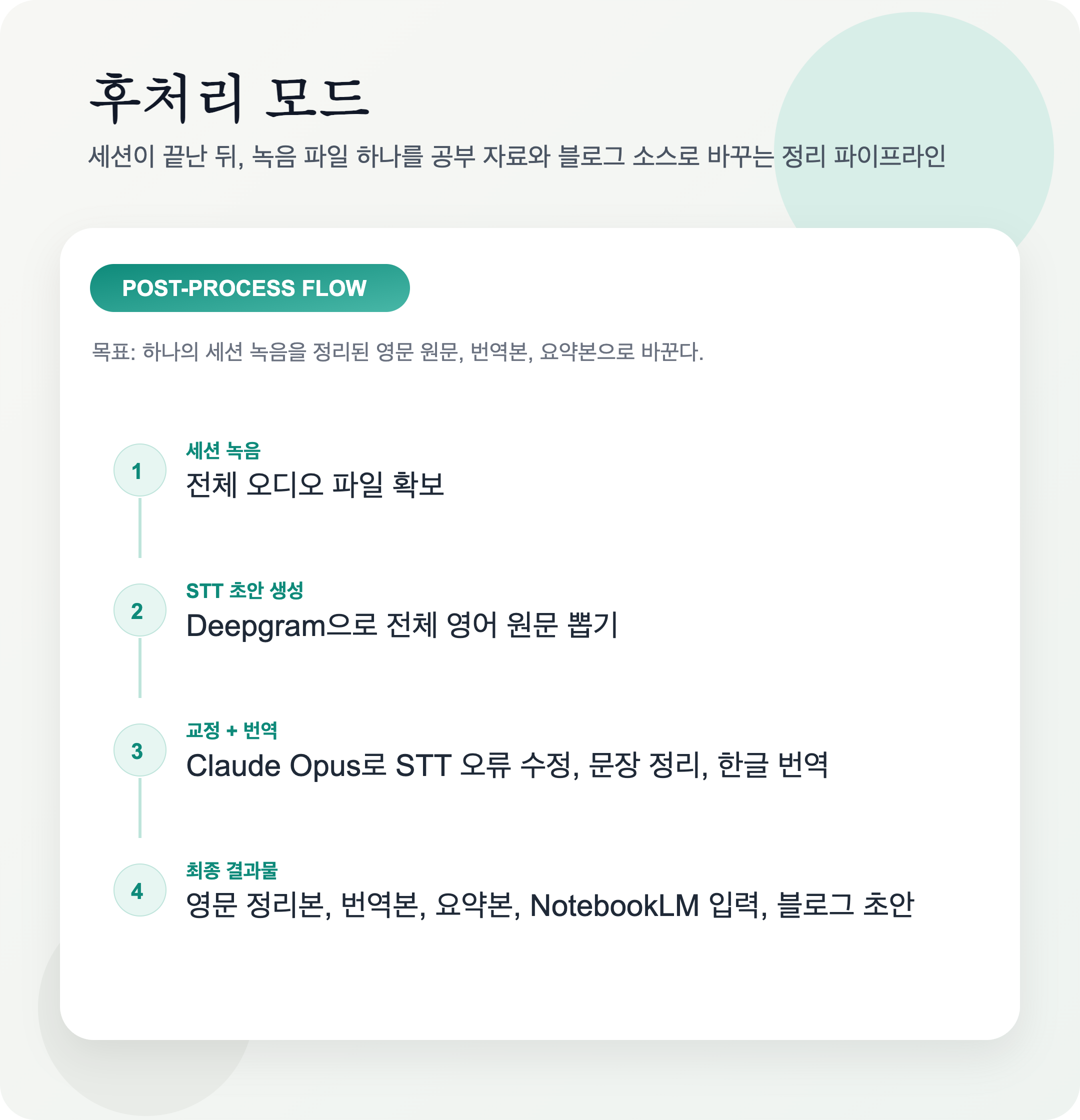

실시간은 절반이다 — 후처리 파이프라인

실시간 번역은 강의장에서 놓치지 않기 위한 것이다. 진짜 자산은 세션이 끝난 뒤에 나온다.

녹음 파일이 있으면 후처리 파이프라인을 돌린다. 흐름은 이렇다.

- Deepgram STT로 전체 세션 녹음을 텍스트로 변환한다

- Claude Opus가 STT 오류를 수정하고, 끊긴 문장을 합치고, 깨끗한 영어 원본을 만든다

- 같은 단계에서 문장 단위 한국어 번역을 붙인다

- 번역 품질을 검수하고 최종본을 출력한다

실시간에서는 GPT-4o mini가 속도 때문에 맞았지만, 후처리에서는 정확도가 중요하다. Opus가 의료 용어 맥락을 잡는 능력이 확실히 다르다.

이렇게 나온 결과물은 세 가지 형태로 쓴다.

- 영어 원본 정리본 — 연사가 실제로 한 말을 깔끔하게 정리한 문서

- 한국어 번역본 — 문장 단위로 대응되는 번역 문서

- 요약 정리본 — 핵심 내용을 추려낸 문서

이걸 Google NotebookLM에 넣으면 발표용 슬라이드를 뽑거나 인포그래픽 소스로 쓸 수 있고, 블로그 글의 소스가 된다. 이번 파커 세미나 블로그 시리즈, 그러니까 Mike Boyle, Andy Galpin, Gary Vee 세션 후기가 전부 이 파이프라인에서 나왔다. 녹음 하나 넣으면 공부 자료, 번역 문서, 블로그 소스가 한꺼번에 나오는 구조다.

완성된 제품은 아니다. UI도 거의 없고, 설정하려면 코드를 직접 봐야 한다. 다른 사람이 바로 가져다 쓰기엔 불편하다.

근데 내가 쓰는 용도로는 됐다. 그걸로 충분하다.

자주 묻는 질문

Deepgram Medical 모델을 쓴 이유는?

의료 전문 용어 인식률 때문이다. 일반 STT는 "proprioception"처럼 일상에서 잘 안 쓰는 의료 용어를 비슷한 발음의 다른 단어로 틀리게 받아적는 경우가 많다. 내가 들은 카이로프랙틱, 스포츠의학 강의에선 의료 특화 모델을 쓰는 편이 훨씬 안정적이었다.

GPT-4o mini를 선택한 이유는?

실시간 자막이라 속도가 최우선이었다. 번역이 2초 안에 나와야 의미가 있다. 4o mini는 내 테스트에선 충분히 빨랐고, 이 용도엔 번역 품질도 쓸 만했다. 세션 후처리처럼 정확도가 더 중요한 단계에서는 Opus를 따로 쓴다.

핸드폰-컴퓨터 연결 방식은 왜 필요했나?

집에서 테스트할 때 노트북 마이크 포집이 잘 안 되는 상황이 있었다. 핸드폰 마이크가 오디오 포집이 더 잘 돼서, IP로 연결해 핸드폰 음성을 컴퓨터로 넘기는 방식을 추가했다. 실제 학회장에서는 오디오 시스템이 좋아서 그냥 노트북으로도 충분했다.

이 글의 결과를 일반화해도 되나?

아직은 아니다. 이 글은 Parker Seminar 2026 현장에서 내가 실제로 써본 개인 기록이다. 세션 음향, 좌석 위치, 와이파이, 장비 성능에 따라 결과는 충분히 달라질 수 있다.

이런 방식이 특히 잘 맞는 사람은?

영어 원문을 100퍼센트 듣긴 어렵지만, 핵심 단어와 문맥이 보이면 따라갈 수 있는 사람에게 특히 잘 맞는다. 번역이 조금 어색해도 원문 자막이 같이 나오면 이해도가 꽤 올라간다.